Quelles solutions pour utiliser les plateformes d’IA avec des données patients ?

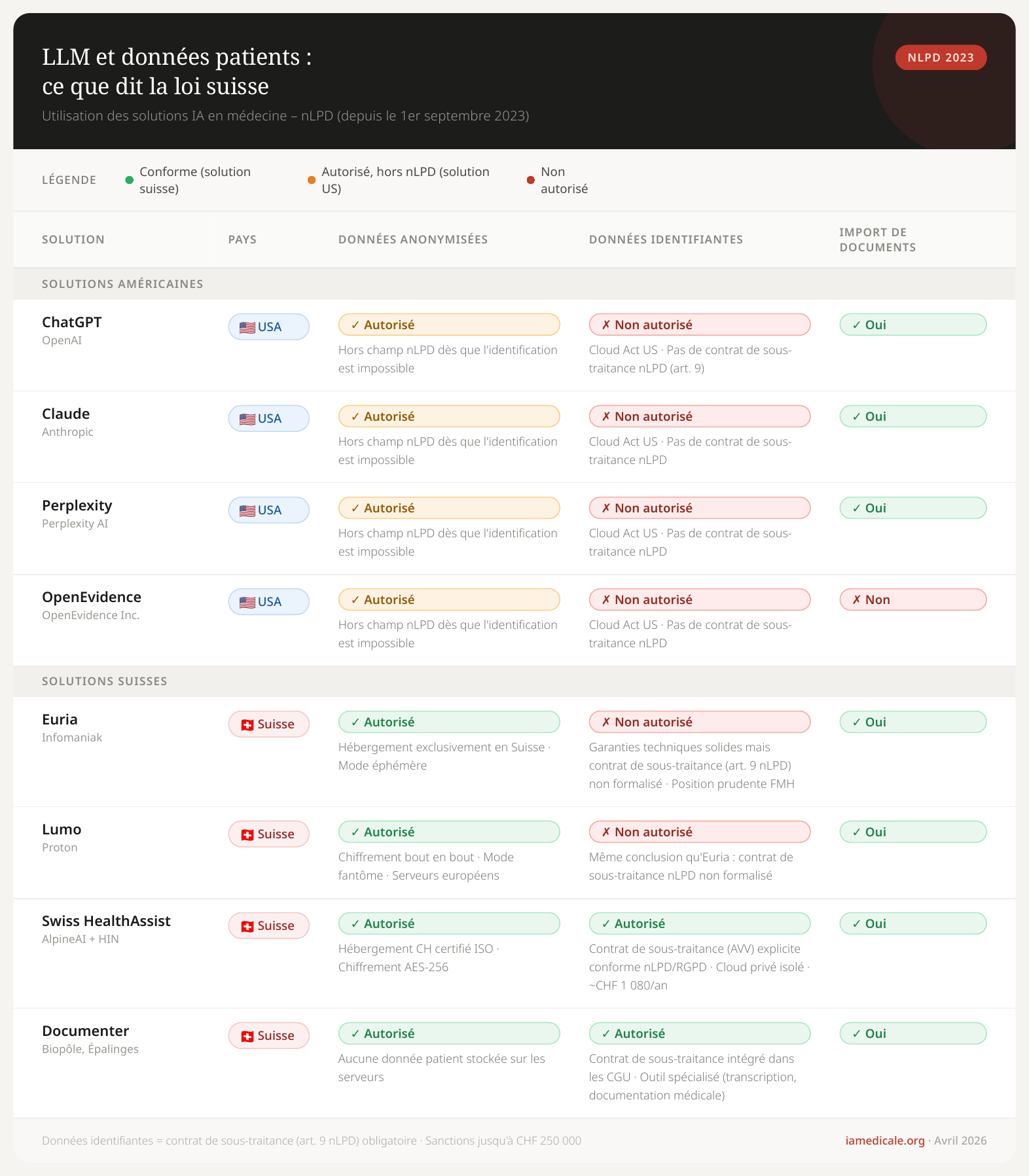

Est-il autorisé d’utiliser ChatGPT avec des données patients ? La réponse est tout simplement non, ceci pour ChatGPT mais aussi pour la très grande majorité des chatbots, donc aussi Gemini, Perpexity ou OpenEvidence. Dans cet article, nous vous présentons les principales options pour utiliser les grands modèles de langage en pratique clinique, qu’il s’agisse de données identifiantes ou anonymisées.

Préambule ; j’ai décidé d’écrire cet article car c’est une question que l’on me pose sans cesse. J’espère que le contenu de cet article est exact mais je ne suis pas juriste. Si des spécialistes du Droit y voient des erreurs ou des imprécisions, merci de me les signaler.

Le cadre légal en trois points

Depuis le 1er septembre 2023, la Suisse applique une nouvelle Loi fédérale sur la Protection des Données (nLPD). Trois aspects sont déterminants pour appréhender ce que cela signifie pour les médecins.

- Premièrement, les données de santé sont des données sensibles.La nLPD les protège explicitement : diagnostics, symptômes, résultats de laboratoire, médicaments, radiographies, etc. Bref tout ce qui transite dans un cabinet médical est considéré comme une donnée personnelle sensible bénéficiant d’une protection renforcée.

- Deuxièmement, le médecin est le responsable du traitement.Ce n’est pas le fournisseur du chatbot. C’est vous. En cas de fuite de données ou de violation de la loi, vous êtes personnellement responsable, avec des sanctions pouvant aller jusqu’à CHF 250’000.

- Troisièmement, les données anonymisées échappent à la nLPD.Dès lors qu’une donnée ne permet plus d’identifier, même indirectement, un patient, elle sort du champ d’application de la loi. C’est cette distinction, identifiante ou anonymisée, qui est au cœur de toute réflexion pratique sur l’usage des LLM.

La notion-clé que peu de médecins connaissent : le contrat de sous-traitance

Quand vous utilisez un grand modèle de langage avec des données patients, le fournisseur de ce LLM devient légalement votre sous-traitant au sens de l’article 9 de la nLPD. La loi exige qu’un contrat de sous-traitance soit conclu, par écrit, définissant notamment les finalités du traitement, les mesures de sécurité, et les obligations du prestataire. L’absence de ce contrat est sanctionnée pénalement.

Alors, quelles solutions ?

La première solution, pas toujours très pratique, est d’anonymiser les données transmises à l’IA. Cette solution est envisageable pour un texte court, elle l’est beaucoup mois si vous souhaiter traiter une plus grande quantité de données, comme l’analyse de plusieurs rapports médicaux par exemple.

Quelles solutions avec des données identifiantes ?

Les LLM américains, c’est non. En pratique, ChatGPT, Claude, Gemini et la plupart des chatbots américains grand public ne remplissent pas ces conditions pour un usage médical avec données identifiantes. La raison principale n’est pas seulement technique, c’est aussi politique : le Cloud Act américain autorise les autorités des États-Unis à accéder légalement à des données hébergées sur des serveurs américains, même si ces serveurs sont physiquement situés en Europe.

Quatre outils passés au crible

- Euria et son mode éphémère : non

Euria est l’assistant IA d’Infomaniak, hébergeur suisse indépendant. Ses points forts sont réels et documentés : données hébergées exclusivement en Suisse, aucune utilisation pour entraîner des modèles, conformité au RGPD et à la LPD suisse. Le mode éphémère permet de démarrer une conversation sans qu’aucune trace ne soit conservée sur les serveurs, même Infomaniak ne peut pas la récupérer. Selon notre compréhension, cela ne suffit cependant pas pour répondre à la nLPD qui exige un contrat de sous-traitance formalisé entre l’utilisateur et Infomaniak.

Interrogé sur ce point, la FMH est d’ailleurs prudente : les déclarations d’Euria sont prometteuses, mais « ne constituent pas un blanc-seing ». Pour un usage avec des données non anonymisées, il faudrait donc aller plus loin que le mode éphémère et disposer d’un contrat de sous-traitance. Conclusion ? Pour ce qui est de la protection des données, Euria est certainement beaucoup mieux que ChatGPT et autres chatbots américains mais ne semble cependant pas répondre aux critères pour une utilisation avec des données sensibles.

- Lumo et son mode fantôme : non

Lumo est l’assistant IA de Proton, la société genevoise connue pour ProtonMail et Proton VPN. Il repose sur des modèles open source (Mistral, OpenHands) hébergés dans des centres de données européens contrôlés par Proton. Son architecture de sécurité est particulièrement soignée : chiffrement de bout en bout des conversations, aucun journal serveur, et un mode fantôme qui efface définitivement la conversation à la fermeture de la fenêtre, sans possibilité de récupération, même par Proton.

Malgré ces qualités, les conclusions sont les mêmes que pour Euria. Les garanties techniques sont solides mais le contrat de sous-traitance formalisé reste une exigence légale indépendante des mesures techniques.

- SwissGPT / Swiss HealthAssist : oui

AlpineAI propose deux produits pertinents pour les médecins : SwissGPT (plateforme généraliste) et Swiss HealthAssist, développé en partenariat avec HIN (Health Info Net), le réseau de messagerie sécurisée des professionnels de santé suisses. SwissGPT affiche une conformité contractuelle explicite : contrat de sous-traitance (AVV) conforme à la nLPD et au RGPD, hébergement dans des centres de données suisses certifiés ISO, chiffrement AES-256, cloud privé isolé.

Swiss HealthAssist peut donc être utilisé avec des données patients. Deux éléments pourraient limiter son utilisation par les professionnels de la santé. Le premier, son prix, CHF 1’080 par an. Le deuxième, à notre connaissance, l’absence d’études suer la qualité des réponses données par Swiss HealthAssist.

- Documenter : oui

Documenter est une startup suisse romande créée par des médecins, basée au Biopôle d’Épalinges. Elle se positionne non pas comme un LLM généraliste, mais comme un outil spécialisé de documentation médicale : transcription ambiante des consultations, analyse de documents, génération de rapports structurés.

Pour ce qui est de la protection des données, on peut lire sur le site de Documenter « Comme un stéthoscope : capte, transmet, oublie tout ». Aucune donnée patient n’est stockée sur nos serveurs. Même avec un mandat judiciaire, nous n’avons rien à fournir. Ce qui n’est jamais enregistré ne peut jamais être volé.

Pour ce qui est de ce fameux contrat de sous-traitance (art. 9 LPD), il est intégré directement dans les Conditions générales d’utilisation et d’abonnement qui sont acceptées par le Client lors de la souscription. Documenter est aussi une solution payante mais comme indiqué ci-dessus. Ses fonctionnalités sont différentes de ceux d’un grand modèle de langage.

Conclusions

La question n’est pas de savoir si les LLM sont utiles en médecine, ils le sont. La question est de savoir comment les utiliser sans mettre en danger vos patients ou votre responsabilité professionnelle.

Deux voies s’offrent à vous

La première, et de loin la plus simple, est l’anonymisation systématique. Avant de soumettre quoi que ce soit à un LLM, supprimez tout élément identifiant. Une donnée anonymisée ne relève plus de la nLPD : vous retrouvez une liberté d’usage totale, y compris avec ChatGPT, Claude ou Gemini, sans démarche supplémentaire. Dans la grande majorité des situations cliniques courantes, c’est suffisant.

La deuxième s’impose lorsque l’anonymisation n’est pas praticable. Choisissez alors une solution conçue pour répondre aux exigences légales : contrat de sous-traitance formalisé, hébergement suisse ou européen, certifications reconnues. Swiss HealthAssist (AlpineAI + HIN) et Documenter sont, à ce jour, les options les mieux documentées pour un usage médical en Suisse.

Image. Les grands modèles de langage américains sont, pour les données non identifiantes, notés « Autorisé » mais en orange. En orange car au travers de vos recherches, même avec des données non identifiantes, vous leur donnez des informations sur vous-même (vos questions, vos domaines de recherche, etc.).